Slide 1 / 全体サマリー

AI Industry Weekly Briefing

2026年5月4日から5月11日を中心に、公式発表・公式ドキュメント・主要メディアで確認したAIニュースを、クライアント共有用のスライド画像としてまとめました。本文の重複を避けるため、詳細は各スライド画像に集約しています。

クライアント説明の冒頭で使う要約

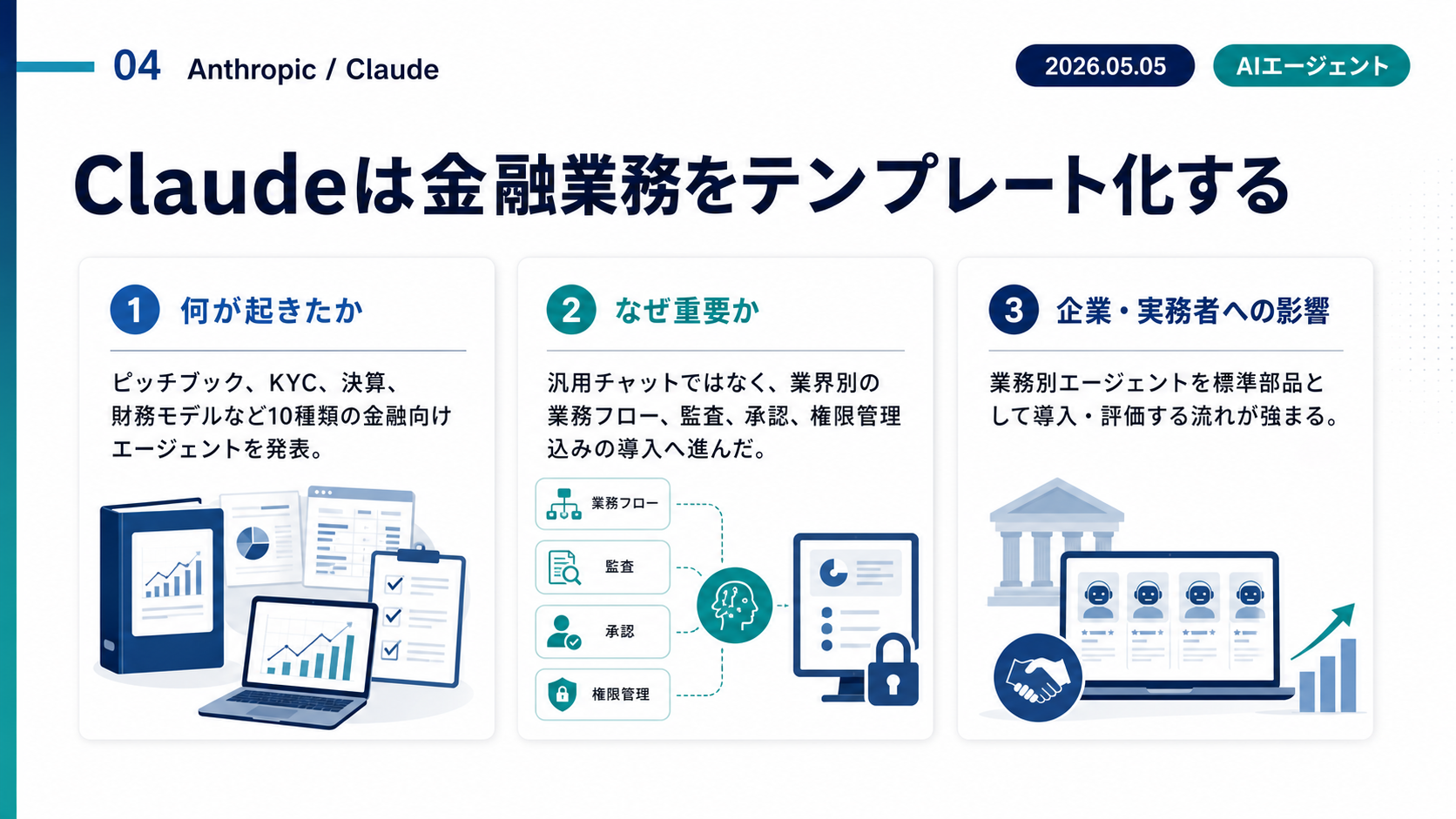

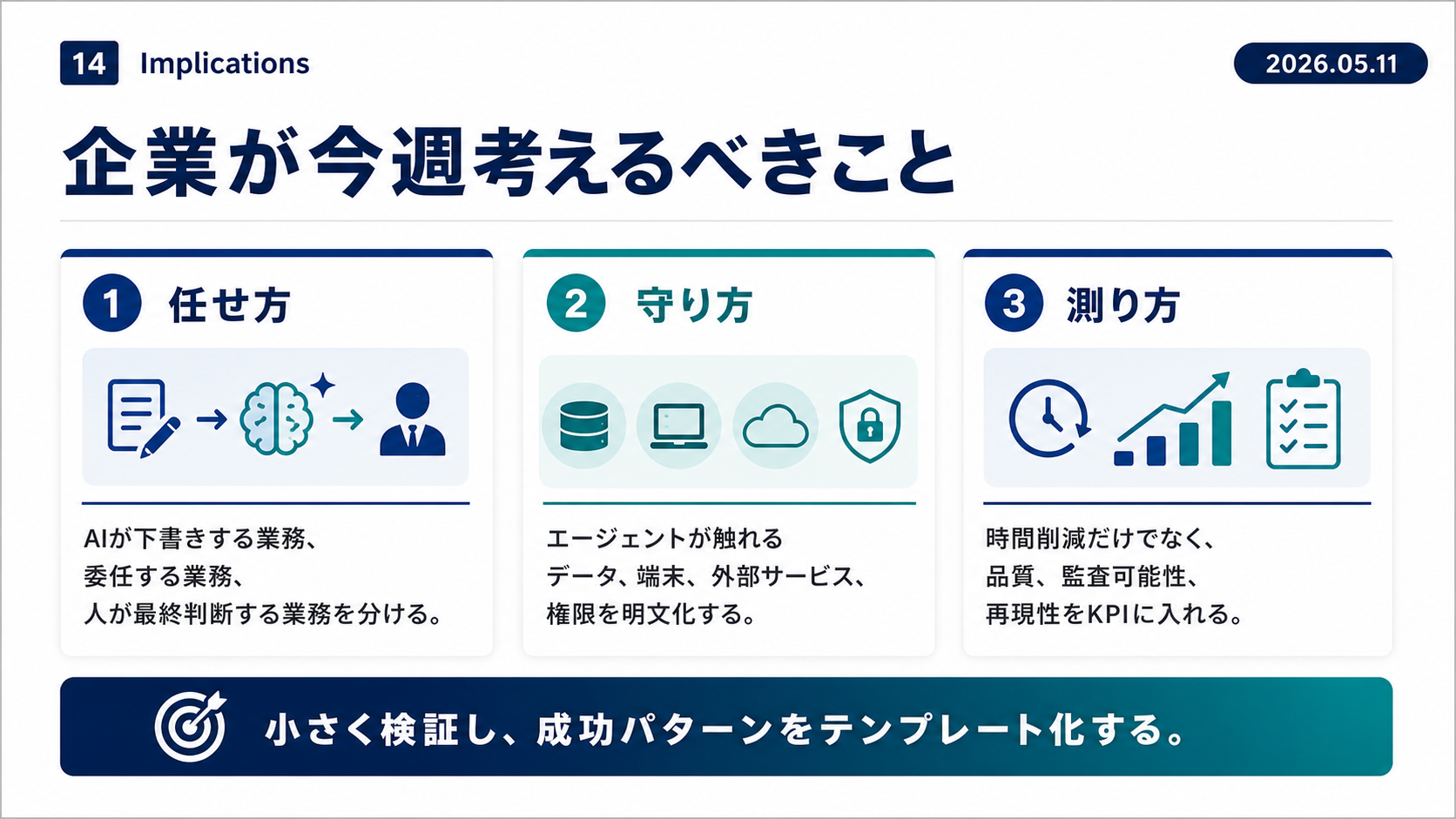

金融、開発、デスクトップ操作、コールセンターまで、実ワークフローに入る発表が集中。

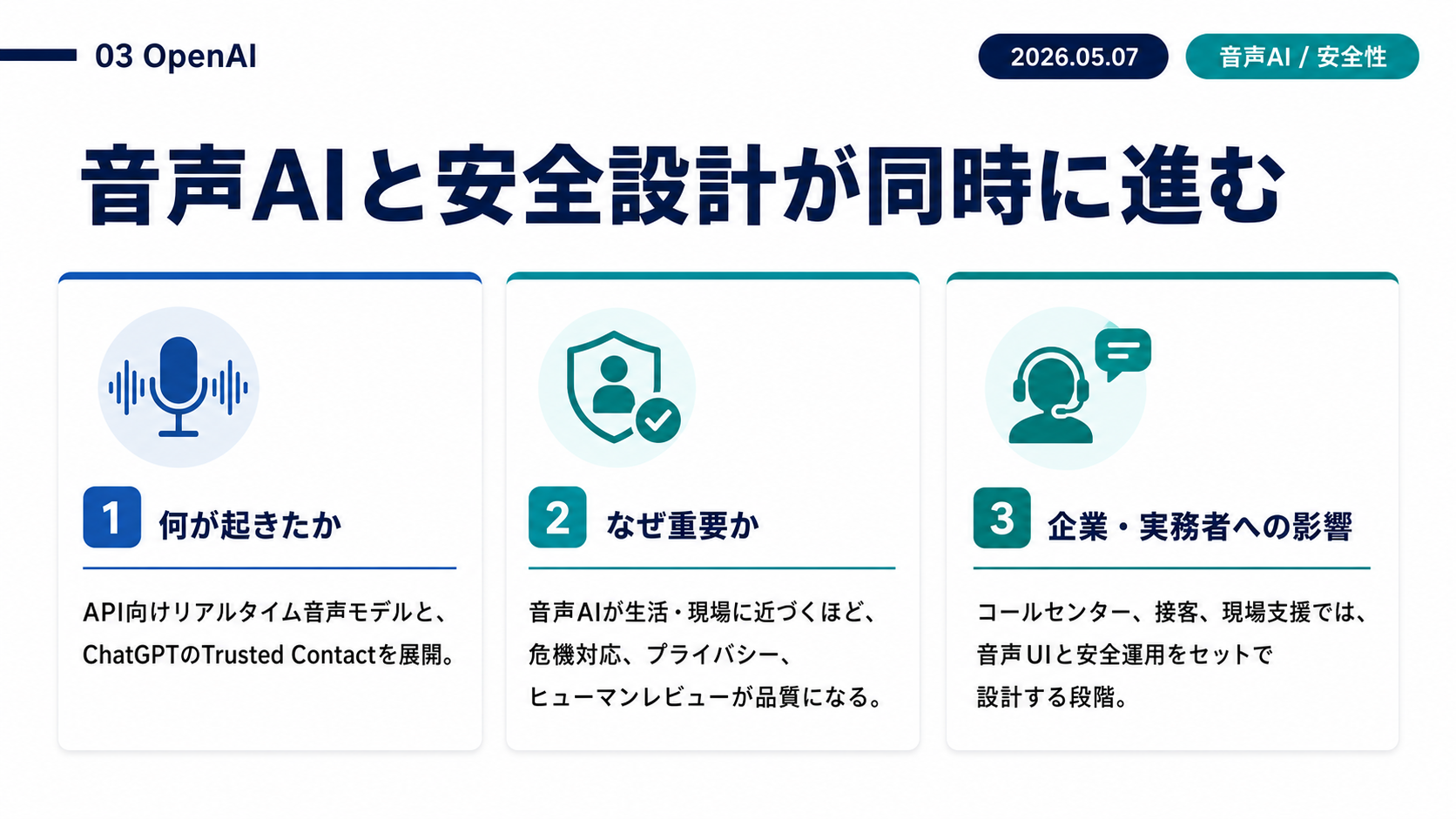

政府評価、AI Control Tower、MCPセキュリティなど、安全に任せるための仕組みが前面へ。

モデル性能だけでなく、GPU、レート制限、ネットワーク効率、利用安定性が差になる。

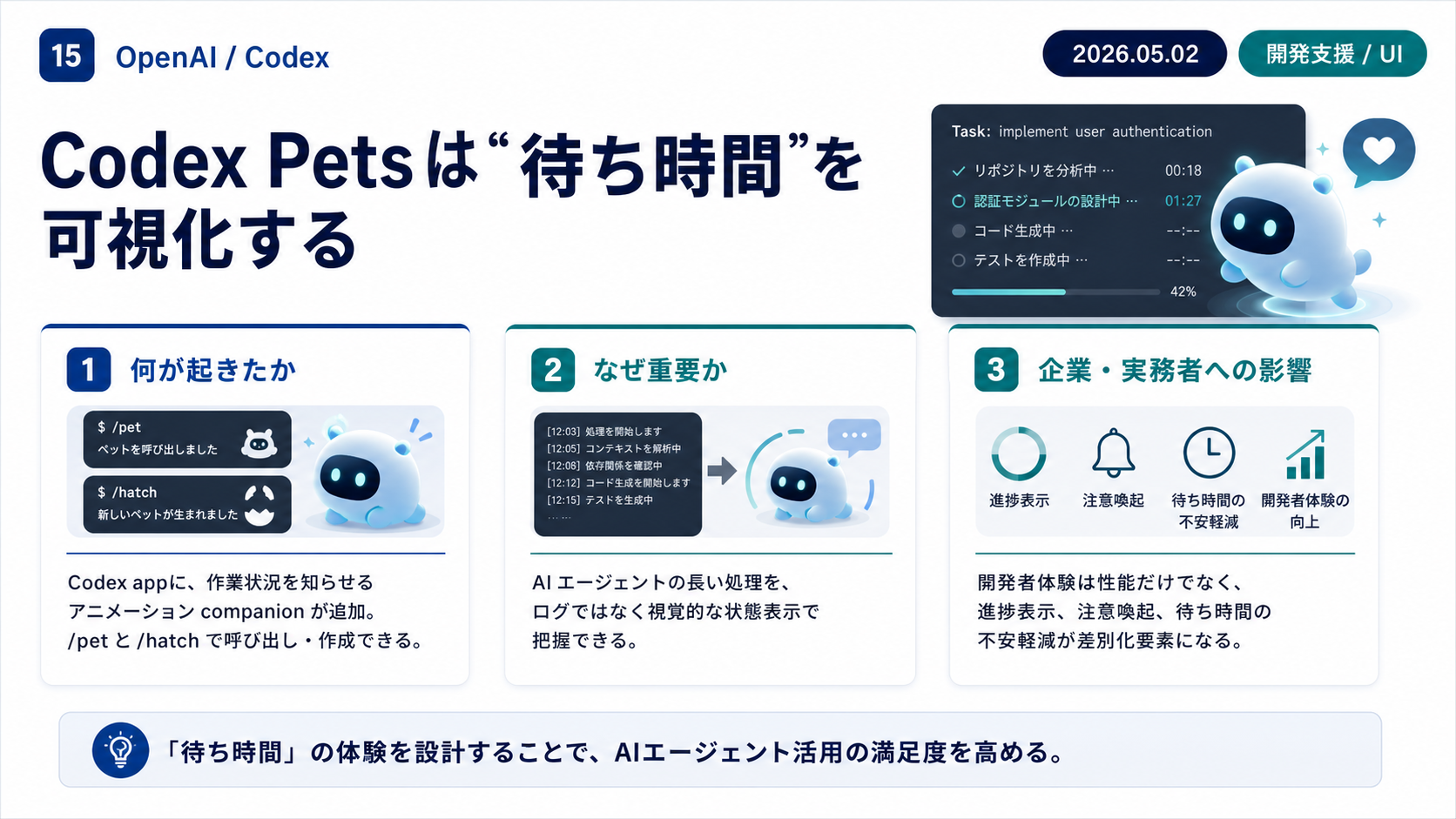

Codex Petsのような中粒度アップデートは、AIエージェントの待ち時間・進捗体験を変える。

気になる項目からスライドへ移動

各画像にニュース内容・重要性・実務影響を集約

今回の修正方針

重複削減: ニュース本文、スライド本文、画像生成プロンプトはHTMLから外し、各スライド画像に内容をまとめました。

拾い漏れ補強: Codex Petsは米国時間2026年5月1日発表、5月2日以降に主要メディアで報道、5月7日に国内記事でも確認されたため、直近動向の補足スライドとして追加しています。

公式発表・公式ドキュメント・主要メディアを優先